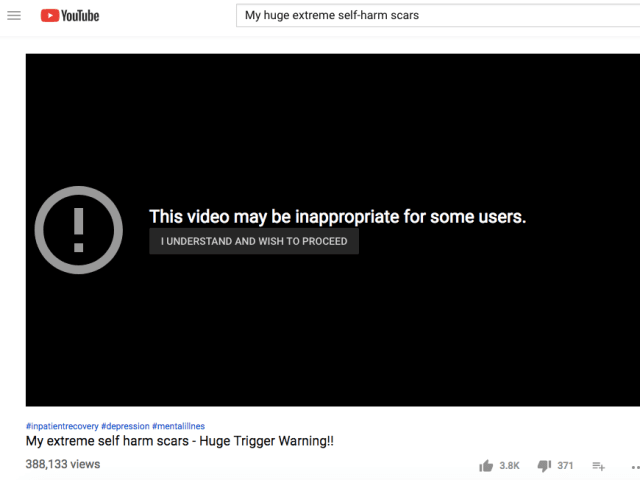

Incident 957: Un prétendu dysfonctionnement de l'algorithme d'Instagram inonde les flux Reels des utilisateurs de contenu violent et explicite

Description: Un prétendu dysfonctionnement de l'algorithme d'Instagram a submergé les flux Reels des utilisateurs de contenus violents et choquants. Nombre d'entre eux ont déclaré avoir vu des morts, des brutalités extrêmes et d'autres contenus choquants en succession rapide, souvent sans avoir consulté de contenu similaire au préalable. Cette exposition soudaine a provoqué une détresse psychologique chez de nombreux utilisateurs, les mineurs et les personnes vulnérables étant particulièrement touchés par ces contenus choquants. Meta a confirmé qu'une défaillance de l'IA était responsable et a présenté ses excuses.

Outils

Nouveau rapportNouvelle RéponseDécouvrirVoir l'historique

Le Moniteur des incidents et risques liés à l'IA de l'OCDE (AIM) collecte et classe automatiquement les incidents et risques liés à l'IA en temps réel à partir de sources d'information réputées dans le monde entier.

Entités

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par Meta , Instagram Reels et Instagram recommendation algorithm, a endommagé minors , Meta users et Instagram users.

Systèmes d'IA présumés impliqués: Instagram Reels et Instagram recommendation algorithm

Statistiques d'incidents

ID

957

Nombre de rapports

1

Date de l'incident

2025-02-28

Editeurs

Dummy Dummy

Rapports d'incidents

Chronologie du rapport

Loading...

Meta, le créateur de l’application Instagram, a présenté ses excuses après que les utilisateurs d’Instagram ont été victimes d’un déluge de violence, de violences, de maltraitance animale et de cadavres sur leurs flux Reels.

Les utilisateur…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents