Incidente 49: A la jueza de belleza de IA no le gustó la piel oscura

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Specification

Physical System

Software only

Level of Autonomy

High

Nature of End User

Amateur

Public Sector Deployment

No

Data Inputs

images of people's faces

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

49

Notes (special interest intangible harm)

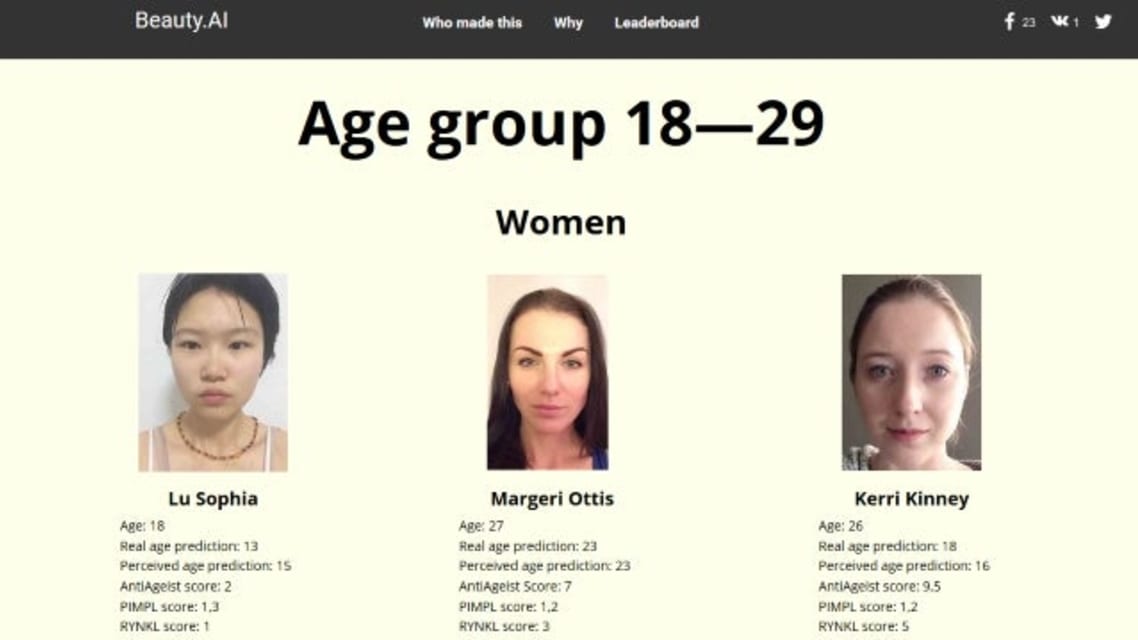

Beauty.ai determined mostly white applicants to be most attractive among all contestants.

Special Interest Intangible Harm

yes

Date of Incident Year

2016

Date of Incident Month

08

Estimated Date

No

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

Imagen: Flickr/Verónica Jauriqui

Los concursos de belleza siempre han sido políticos. Después de todo, ¿qué habla con más fuerza de cómo nos vemos unos a otros que qué rasgos físicos recompensamos como hermosos y cuáles codificamos como feo…

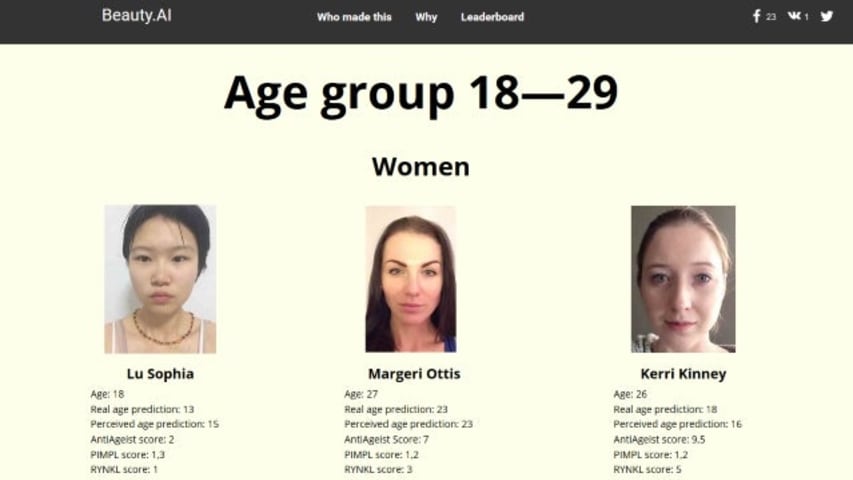

El primer concurso internacional de belleza decidido por un algoritmo ha generado controversia luego de que los resultados revelaran un factor evidente que vincula a los ganadores.

Se suponía que el primer concurso internacional de belleza …

Solo unos pocos ganadores eran asiáticos y uno tenía piel oscura, la mayoría eran blancos.

Apenas unos meses después de que la inteligencia artificial Tay de Microsoft enviara mensajes racistas en Twitter, otra IA parece haber seguido su ej…

El primer concurso internacional de belleza decidido por un algoritmo ha generado controversia luego de que los resultados revelaran un factor evidente que vincula a los ganadores.

Se suponía que el primer concurso internacional de belleza …

Con más de 6.000 postulantes de más de 100 países compitiendo, acaba de finalizar el primer concurso internacional de belleza juzgado íntegramente por inteligencia artificial. Los resultados son un poco desalentadores.

El equipo de jueces, …

No es la primera vez que la inteligencia artificial está en el centro de atención por un aparente racismo, pero los resultados recientes de la competencia de Beauty.AI han causado controversia al favorecer claramente la piel clara.

La compe…

Si te unes a los concursos de belleza o simplemente los miras, ¿qué sentirías acerca de un algoritmo informático que juzgue los atributos faciales de una persona? Tal vez deberíamos preguntarles a quienes realmente se ofrecieron como volunt…

Una IA diseñada para hacer X eventualmente fallará en hacer X. Los filtros de spam bloquean correos electrónicos importantes, el GPS proporciona direcciones defectuosas, las traducciones automáticas corrompen el significado de las frases, l…

Durante mucho tiempo se pensó que los robots equipados con inteligencia artificial serían la contraparte fría y puramente objetiva de la subjetividad emocional de los humanos. Desafortunadamente, parecería que muchas de nuestras imperfeccio…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Amazon’s Experimental Hiring Tool Allegedly Displayed Gender Bias in Candidate Rankings

Gender Biases in Google Translate

TayBot

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Amazon’s Experimental Hiring Tool Allegedly Displayed Gender Bias in Candidate Rankings

Gender Biases in Google Translate