概要: 報道によると、イーロン・マスク氏は、ドナルド・トランプ大統領の政治的意図に関するカマラ・ハリス氏の投稿に応えて、ハリス氏を「共産主義独裁者」として描いたAI生成画像をXで共有したという。

Alleged: xAI developed an AI system deployed by xAI , X (Twitter) と Elon Musk, which harmed Kamala Harris と General public.

インシデントのステータス

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

3.1. False or misleading information

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Misinformation

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

インシデントレポート

レポートタイムライン

Loading...

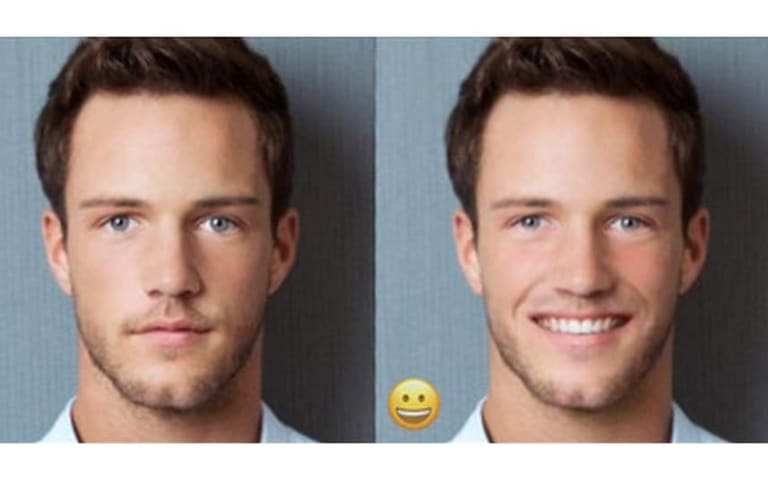

テック界の大富豪イーロン・マスク氏は、ドナルド・トランプ氏が「就任初日に独裁者になることを誓う」と書いたカマラ・ハリス氏のXへの投稿に反応した。マスク氏はこの投稿を、AIが生成したと思われるカマラ・ハリス氏の写真とともに再共有した。この写真では、副大統領が共産主義の支配者として描かれている。

「カマラは就任初日に共産主義の独裁者になることを誓う。彼女があの服を着ているなんて信じられるか?」とマスク氏は投稿のキャプションに書いた。投稿は以下の通り。

この投稿はソーシャルメディア…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents