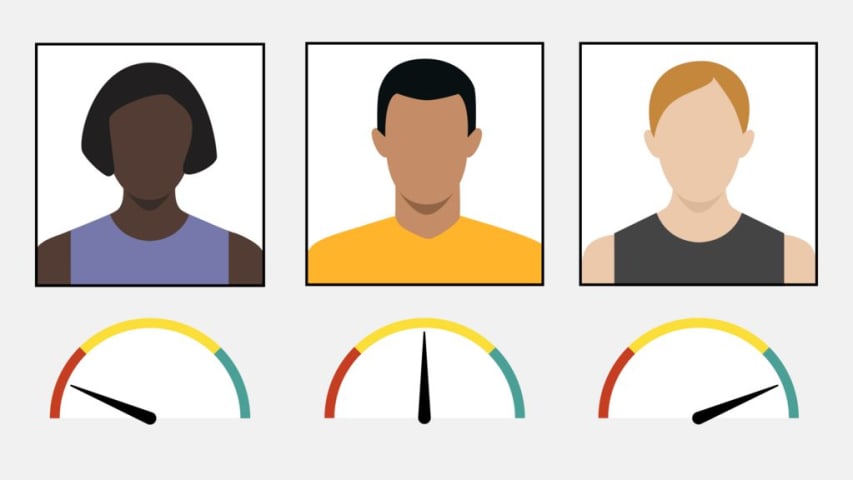

概要: 2023年3月から2024年5月にかけて、エセックス在住のブランドン・タイラーはAIを用いて、16歳を含む少なくとも20人の個人的に知り合いの女性をモデルにした露骨なディープフェイクポルノを生成した。彼は彼女たちのソーシャルメディア上の写真を操作し、個人情報とともに、性暴力を助長するオンラインフォーラムで共有した。彼は2025年4月、性的に露骨なディープフェイクの共有を禁じる英国の刑法に基づき、懲役5年の判決を受けた。これは、この種の訴追としては初の大規模訴追の一つとなる。

Editor Notes: Notes on the timeline: Brandon Tyler's actions reportedly began sometime in March 2023 and continued until May 2024, which is when he was arrested. He was sentenced on April 4, 2025 (which is the incident date selected for this incident ID). It is also the date when reporting seemingly emerged for this incident.

Alleged: Unknown deepfake technology developer developed an AI system deployed by Brandon Tyler, which harmed Victims of Brandon Tyler と General public.

関与が疑われるAIシステム: Unknown deepfake technology apps

インシデントのステータス

インシデントID

1013

レポート数

1

インシデント発生日

2025-04-04

エディタ

Dummy Dummy

インシデントレポート

レポートタイムライン

Loading...

人工知能(AI)を使って知り合いの女性のディープフェイクポルノを作成したオンラインの変質者が、5年の懲役刑を言い渡された。

ブランドン・タイラー(26歳)はソーシャルメディアのページから画像を操作し、「レイプ文化」を賛美するフォーラムに投稿したと、チェルムズフォード刑事法院で審理された。

エセックス州ブレインツリー出身のバー従業員であるタイラーは、裁判官から「最悪の有害な男らしさを示している」と評された。

彼は、暴力を伴わない嫌がらせ行為18件と、性的満足のために他人の親密な…

バリアント

「バリアント」は既存のAIインシデントと同じ原因要素を共有し、同様な被害を引き起こし、同じ知的システムを含んだインシデントです。バリアントは完全に独立したインシデントとしてインデックスするのではなく、データベースに最初に投稿された同様なインシデ�ントの元にインシデントのバリエーションとして一覧します。インシデントデータベースの他の投稿タイプとは違い、バリアントではインシデントデータベース以外の根拠のレポートは要求されません。詳細についてはこの研究論文を参照してください

似たようなものを見つけましたか?

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents

よく似たインシデント

Did our AI mess up? Flag the unrelated incidents