Description: Yahoo Boys (from Nigeria and Ghana) and scammers from Morocco are reportedly targeting U.S. widows and vulnerable individuals using AI-generated images and fake military profiles in "Artificial Patriot" scams. They have allegedly impersonated military officials such as General Matthew W. McFarlane to gain trust, sharing fabricated backstories and emotional appeals. Once trust is established, they request money through untraceable methods.

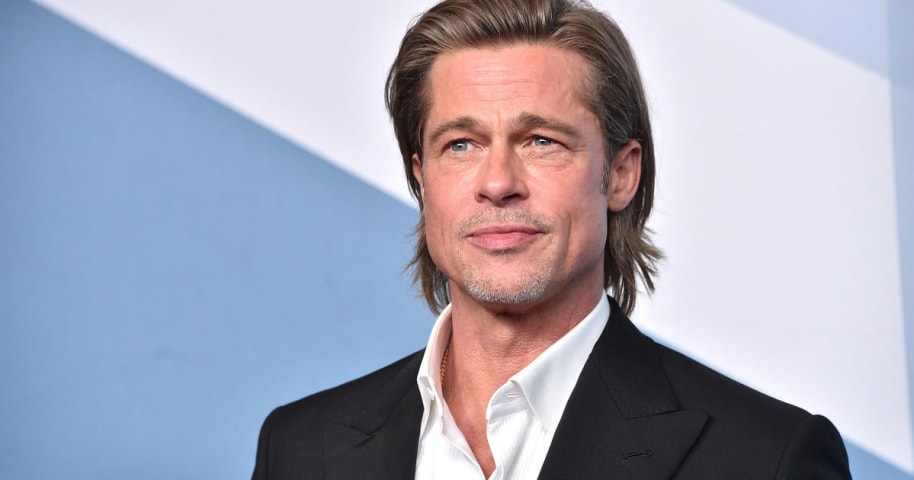

Editor Notes: The Yahoo Boys are reportedly not so much a centralized group as a loosely connected network of individuals and small clusters engaging in cybercrime schemes. In French-language reporting, they are usually referred to as "brouteurs," while in English-language reporting, they are often identified as "Yahoo Boys." While the Yahoo Boys have reportedly been experimenting with deepfake technology since sometime in 2021 or 2022, the incident date of 09/23/2024 is based off of initial reporting on American Patriot scams. See Incident 911 for more general reporting on Yahoo Boys using deepfakes for romance scams. See Incident 901 for a specific example of how three Yahoo Boys allegedly defrauded a French woman of $850,000 by posing as Brad Pitt. See Incident 913 for information pertaining to their use of AI to allegedly impersonate news organizations to blackmail victims.

Entités

Voir toutes les entitésAlleged: Unknown deepfake technology developers developed an AI system deployed by Yahoo Boys , Scammers from West Africa , Scammers from Nigeria , Scammers from Morocco , Scammers from Ghana et Brouteurs, which harmed Widows , Matthew W. McFarlane , Impersonated American military officials , Emotionally vulnerable individuals et American widows.

Système d'IA présumé impliqué: Unknown deepfake apps

Statistiques d'incidents

ID

912

Nombre de rapports

2

Date de l'incident

2024-11-21

Editeurs

Dummy Dummy

Rapports d'incidents

Chronologie du rapport

Loading...

Des escrocs étrangers utilisent l'intelligence artificielle pour créer de faux profils militaires très convaincants, ciblant certains des membres les plus vulnérables de la société : les veuves américaines. Ces soi-disant « patriotes artifi…

Loading...

ATLANTA (InvestigateTV) --- Le soldat doublement amputé tient un gâteau et demande des vœux d'anniversaire. Les Américains patriotes aiment, commentent et partagent la publication avec leurs abonnés.

Mais le soldat n'est pas réel. Il a été …

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?