Incident 909: La campagne Matriochka utiliserait des deepfakes pour se faire passer pour des universitaires à des fins de propagande pro-russe.

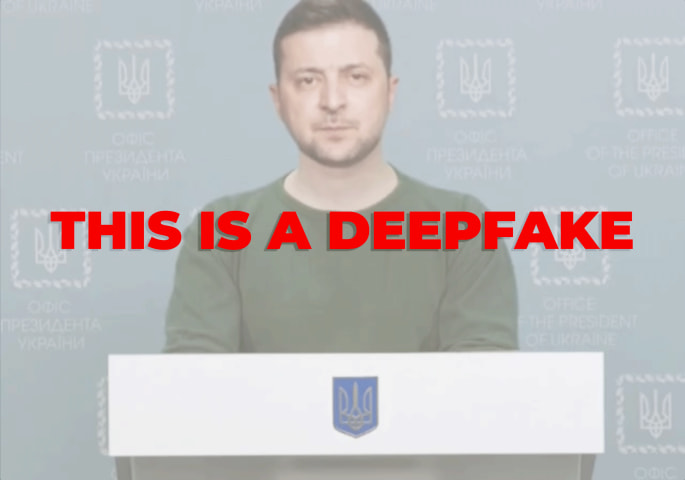

Description: La campagne de désinformation Matriochka aurait utilisé l'IA pour se faire passer pour des universitaires, diffusant des allégations soutenant la Russie et appelant à la capitulation de l'Ukraine. Ces vidéos auraient déformé les opinions des universitaires afin d'amplifier la propagande pro-russe. La campagne aurait exploité les réseaux sociaux mondiaux pour tromper les spectateurs et saper la confiance dans les voix universitaires crédibles, tout en alimentant la désinformation sur le conflit ukrainien.

Editor Notes: Reconstructing the reported timeline of events: (1) September 2023: The Matryoshka disinformation campaign reportedly began, allegedly producing anti-Ukrainian propaganda and distributing it via stolen accounts and bots on platforms like X and Telegram. (2) November 2023: Reports from Viginum reportedly revealed similarities between Matryoshka and Russia's GRU-linked Doppelgänger network, allegedly indicating potential shared origins. (3) Early 2024: The campaign allegedly began using AI to generate deepfake videos of academics from institutions like Cambridge and Harvard. (4) November 2024: The University of Bristol reportedly verified that a video falsely attributing political statements to historian Ronald Hutton was allegedly AI-manipulated. (5) December 13, 2024 (the date for this Incident ID): An investigation by The Insider reportedly confirmed that Matryoshka videos allegedly misrepresented academics’ voices to spread pro-Russian propaganda, with the footage heavily promoted in multiple languages by allegedly stolen social media accounts. When studying this incident, please also refer to Incidents 929, 931, 1060, and 1061. While Incident 931 has not been explicitly attributed to Operation Overload (also known as Matryoshka or Storm-1679), its thematic content and manipulation tactics appear adjacent. (No direct forensic or institutional linkage has been established as of this writing.)

Outils

Nouveau rapportNouvelle RéponseDécouvrirVoir l'historique

Le Moniteur des incidents et risques liés à l'IA de l'OCDE (AIM) collecte et classe automatiquement les incidents et risques liés à l'IA en temps réel à partir de sources d'information réputées dans le monde entier.

Entités

Voir toutes les entitésAlleged: Unknown deepfake technology developers developed an AI system deployed by Storm-1679 , Russian entities linked to GRU , Reliable Russian News , Operation Overload et Matryoshka, which harmed Ronald Hutton , Academics targeted by Storm-1679 , Academics targeted by Operation Overload et Academics targeted by Matryoshka.

Statistiques d'incidents

ID

909

Nombre de rapports

3

Date de l'incident

2024-12-13

Editeurs

Dummy Dummy

Rapports d'incidents

Chronologie du rapport

Loading...

Le réseau de désinformation russe Matrioshka a lancé une nouvelle campagne visant à convaincre les utilisateurs des réseaux sociaux que des universitaires et des professeurs des meilleures universités mondiales appellent l'Occident à lever …

Loading...

Le réseau de désinformation russe Matrioshka a lancé une nouvelle campagne sur le réseau social Bluesky. Eliot Higgins, fondateur du groupe de journalisme d'investigation Bellingcat, a été l'un des premiers chercheurs à détecter son activit…

Loading...

Les premiers symptômes de désinformation apparaissent sur le réseau social Bluesky, avec des échos de la campagne prorusse « Matriochka » qui a inondé le X d’Elon Musk – mais avec quelques rebondissements.

Le collectif @antibot4navalny, spé…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?