Incident 546: Un algorithme de distribution des aides sociales aurait simplifié à outrance la vulnérabilité économique

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Selon une enquête publiée ce matin par Human Surveillance des droits.

Le système algorithmique, appelé Takaful, classe les familles demandant une aide du moins pauvre au plus pauvre à l'aide d'un calcul secret qui attribue des poids à 57 in…

Résumé

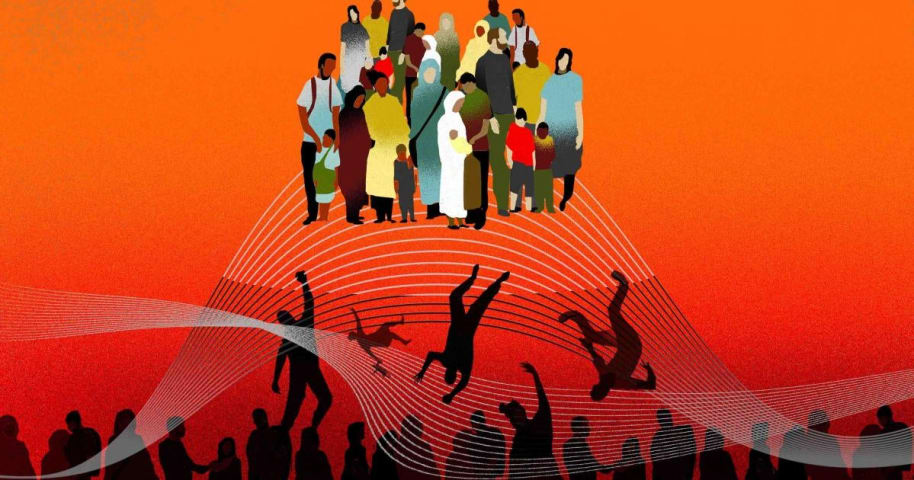

Les gouvernements du monde entier se tournent vers l'automatisation pour les aider à fournir des services publics essentiels, tels que la nourriture, le logement et l'aide en espèces. Mais certaines formes d'automatisation excluent d…

Selon un [rapport](https://www.hrw.org/report/ 2023/06/13/automated-neglect/how-world-banks-push-allocate-cash-assistance-using-algorithms#_ftn102) par Human Rights Watch. Mais un algorithme utilisé par un gouvernement jordanien, qui classa…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Northpointe Risk Models

Gender Biases in Google Translate

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Northpointe Risk Models