Incident 49: Le juge de beauté de l'IA n'aimait pas la peau foncée

Entités

Voir toutes les entitésClassifications de taxonomie CSETv0

Détails de la taxonomieProblem Nature

Specification

Physical System

Software only

Level of Autonomy

High

Nature of End User

Amateur

Public Sector Deployment

No

Data Inputs

images of people's faces

Classifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

49

Notes (special interest intangible harm)

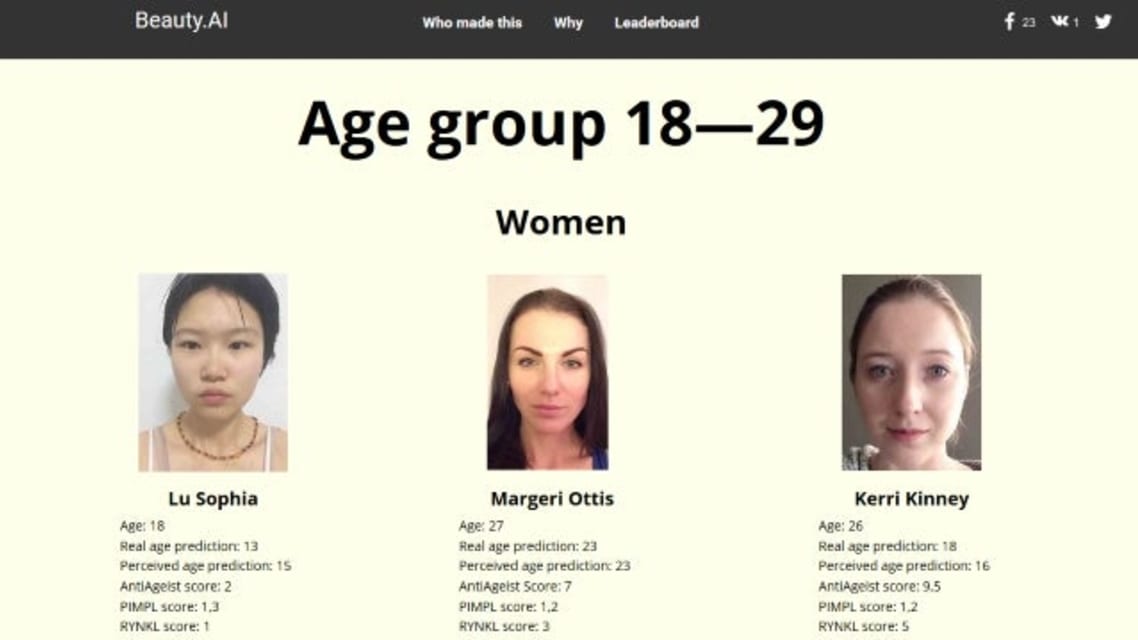

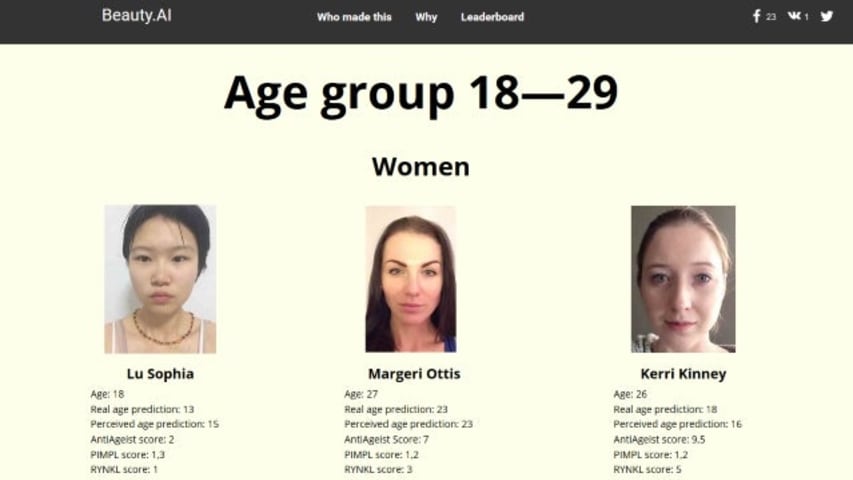

Beauty.ai determined mostly white applicants to be most attractive among all contestants.

Special Interest Intangible Harm

yes

Date of Incident Year

2016

Date of Incident Month

08

Estimated Date

No

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

Image : Flickr/Veronica Jauriqui

Les concours de beauté ont toujours été politiques. Après tout, qu'est-ce qui parle plus fortement de la façon dont nous nous voyons que les traits physiques que nous récompensons comme beaux et que nous cod…

Le premier concours international de beauté décidé par un algorithme a suscité la controverse après que les résultats ont révélé un facteur flagrant liant les gagnants

Le premier concours international de beauté jugé par des « machines » ét…

Seuls quelques gagnants étaient asiatiques et un avait la peau foncée, la plupart étaient blancs

Quelques mois seulement après que l'intelligence artificielle Tay de Microsoft a envoyé des messages racistes sur Twitter, une autre IA semble …

Le premier concours international de beauté décidé par un algorithme a suscité la controverse après que les résultats ont révélé un facteur flagrant liant les gagnants

Le premier concours international de beauté jugé par des « machines » ét…

Avec plus de 6 000 candidats de plus de 100 pays en compétition, le premier concours international de beauté jugé entièrement par l'intelligence artificielle vient de se terminer. Les résultats sont un peu décourageants.

L'équipe de juges, …

Ce n'est pas la première fois que l'intelligence artificielle est à l'honneur pour un racisme apparent, mais les récents résultats des concours de Beauty.AI ont suscité la controverse en favorisant clairement les peaux claires.

Le concours,…

Si vous participez à des concours de beauté ou si vous les regardez simplement, que penseriez-vous d'un algorithme informatique jugeant les attributs faciaux d'une personne ? Peut-être devrions-nous demander à ceux qui se sont réellement po…

Une IA conçue pour faire X finira par échouer à faire X. Les filtres anti-spam bloquent les e-mails importants, le GPS fournit des directions erronées, les traductions automatiques corrompent le sens des phrases, la correction automatique r…

On a longtemps pensé que les robots dotés d'intelligence artificielle seraient le pendant froid et purement objectif de la subjectivité émotionnelle des humains. Malheureusement, il semblerait que beaucoup de nos imperfections se soient ret…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Amazon’s Experimental Hiring Tool Allegedly Displayed Gender Bias in Candidate Rankings

Gender Biases in Google Translate

TayBot

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Amazon’s Experimental Hiring Tool Allegedly Displayed Gender Bias in Candidate Rankings

Gender Biases in Google Translate