Incident 479: Une vidéo Instagram présente un deepfake audio du président américain tenant des propos transphobes

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

1.2. Exposure to toxic content

Risk Domain

- Discrimination and Toxicity

Entity

Human

Timing

Post-deployment

Intent

Intentional

Rapports d'incidents

Chronologie du rapport

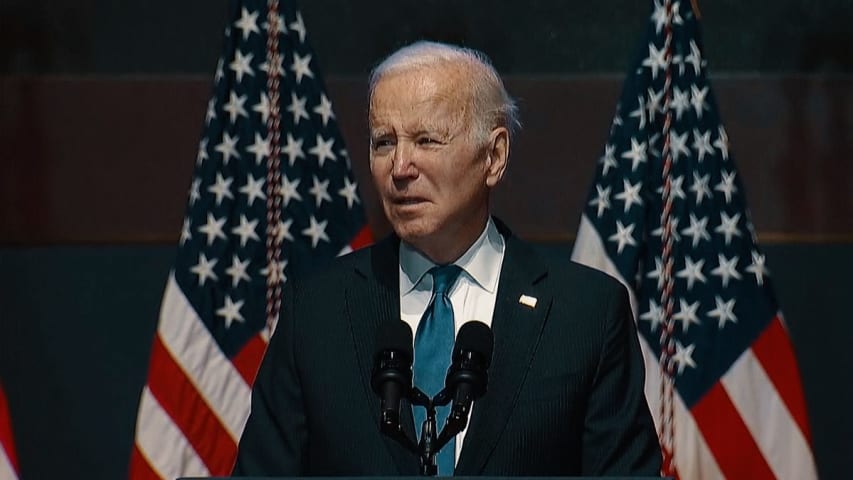

Une vidéo deepfake du président Joe Biden critiquant durement les femmes transgenres est partagée sur les réseaux sociaux. Bien que la voix sur la vidéo puisse ressembler à Biden, les mots qui sortent de sa bouche sont contraires à son sout…

L'affirmation: une vidéo montre le président Joe Biden faisant des remarques transphobes dans un discours

Un fév. 3 vidéo Instagram montre le président Joe Biden prononçant un discours avec ce qui semble être un son insultant les femmes tr…

Un clip qui montre apparemment le président américain Joe Biden faisant des remarques transphobes a été partagé sur les réseaux sociaux comme s'il était authentique. Il n'y a aucune preuve qu'il ait fait de telles déclarations, cependant, e…

NEW YORK – Dans une vidéo d'un reportage du 25 janvier, le président Joe Biden parle de chars. Mais une version trafiquée de la vidéo a amassé des centaines de milliers de vues cette semaine sur les réseaux sociaux, ce qui donne l'impressio…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents