Incident 451: Les données de formation de Stable Diffusion contenaient des images protégées par le droit d'auteur

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

6.3. Economic and cultural devaluation of human effort

Risk Domain

- Socioeconomic & Environmental Harms

Entity

AI

Timing

Post-deployment

Intent

Intentional

Rapports d'incidents

Chronologie du rapport

Bonjour. C'est Matthew Butterick. Je suis écrivain, designer, programmeur et avocat. En novembre 2022, j'ai fait équipe avec les incroyablement excellents plaideurs en recours collectif [Joseph Saveri](https://saverilawfirm.com/attorneys/jo…

/cdn.vox-cdn.com/uploads/chorus_asset/file/24365786/Screenshot_2023_01_17_at_09.55.27.png)

Getty Images poursuit Stability AI, créateurs de l'outil d'art d'IA populaire Stable Diffusion, pour violation présumée du droit d'auteur.

Dans un communiqué de presse partagé avec The Verge, la société de photos a déclaré qu'elle pensait q…

/cloudfront-us-east-2.images.arcpublishing.com/reuters/RF6CYGDZ6VLP3DBWF2KXT3CPVQ.jpg)

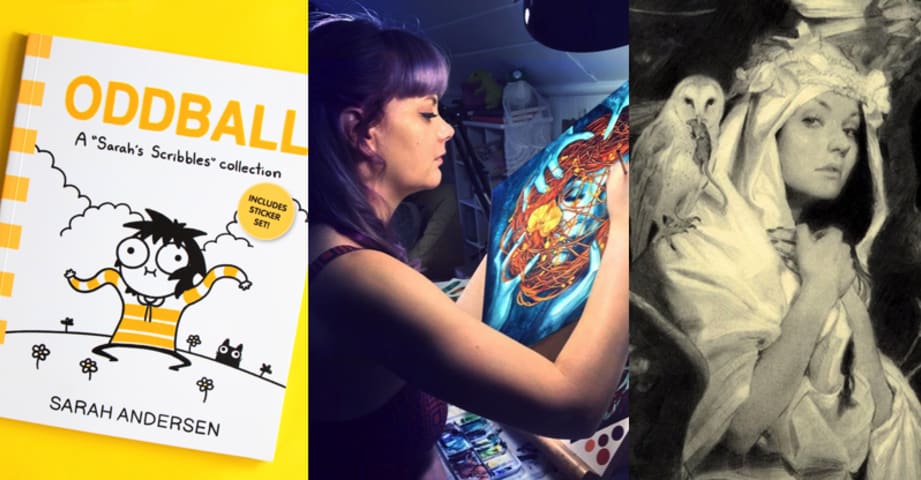

(Reuters) – Un groupe d'artistes visuels a poursuivi les sociétés d'intelligence artificielle Stability AI Ltd, Midjourney Inc et DeviantArt Inc pour violation du droit d'auteur, s'ajoutant à une série de litiges en matière de propriété int…

Cette semaine, Getty Images a engagé une procédure judiciaire devant la Haute Cour de justice de Londres contre Stability AI, affirmant que Stability AI avait enfreint les droits de propriété intellectuelle, y compris les droits d'auteur su…

** Les combinaisons d'IA arrivent… ** [Generative AI] (https://snacks.robinhood.com/newsletters/3WEG5SgBgeQScK91kmZwOc/articles/6gWjpZswZYcdRi0vcvZQos/) a explosé au cours de la dernière année, avec des outils comme ChatGPT et Stable Diffus…

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

/cdn.vox-cdn.com/uploads/chorus_asset/file/24365786/Screenshot_2023_01_17_at_09.55.27.png)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/RF6CYGDZ6VLP3DBWF2KXT3CPVQ.jpg)