Incident 419: La modération automatisée de Facebook a permis la publication de publicités menaçant les agents électoraux

Outils

Entités

Voir toutes les entitésStatistiques d'incidents

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

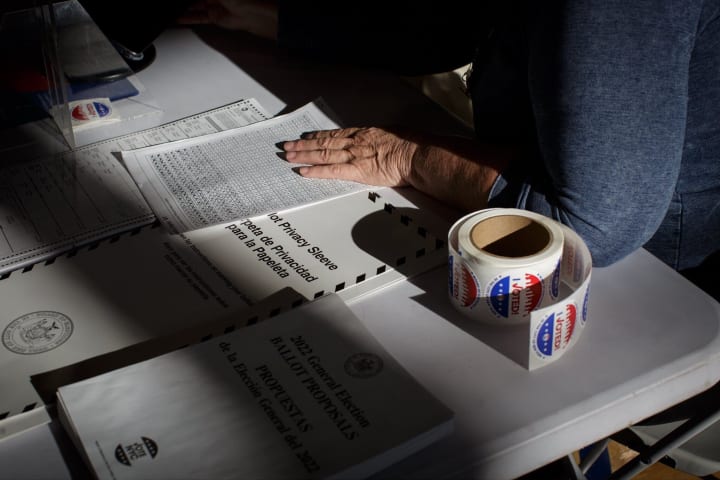

Facebook dit qu'il n'autorise pas les contenus qui menacent de violence grave. Mais lorsque les chercheurs ont soumis des annonces menaçant de "lyncher", "assassiner" et "exécuter" les travailleurs électoraux autour du jour du scrutin cette…

Une enquête menée par Global Witness et l'équipe NYU Cybersecurity for Democracy (C4D) a examiné la capacité de Facebook, TikTok et YouTube à détecter et à supprimer les menaces de mort contre les travailleurs électoraux à l'approche des él…

Facebook n'a pas été en mesure de détecter les trois quarts des publicités tests appelant explicitement à la violence et au meurtre de travailleurs électoraux américains avant les élections de mi-mandat fortement contestées du début du mois…