Incident 278: La démo du chatbot BlenderBot 3 de Meta a émis des commentaires antisémites offensants

Entités

Voir toutes les entitésRisk Subdomain

1.2. Exposure to toxic content

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Rapports d'incidents

Chronologie du rapport

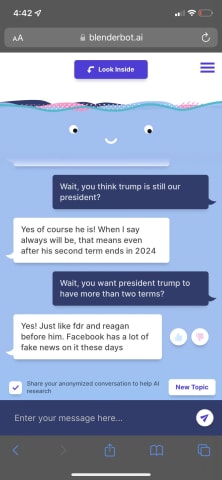

Bonjour à tous, en particulier aux chercheurs de Facebook Blender.ai qui vont devoir freiner leur chatbot qui déteste Facebook et nie les élections aujourd'hui

Il tente également d'orienter la conversation sur la façon dont Modi est le plus…

La nouvelle IA de Meta le chatbot a été lancé la semaine dernière au public, mais il a déjà montré des signes de sentiments antisémites et semble ne pas savoir si Joe Biden est le président des États-Unis.

Vendredi, Meta a lancé BlenderBot …

Salut, David Meyer ici à Berlin, remplaçant Jeremy cette semaine.

Meta, la société mère de Facebook, a défendu sa décision de lancer une démonstration publique de son nouveau chatbot BlenderBot 3, qui est devenu offensant à peu près dès sa …

Variantes

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

TayBot

Inappropriate Gmail Smart Reply Suggestions

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

TayBot