Incident 162: L'ETS a utilisé des preuves de reconnaissance vocale prétendument défectueuses pour accuser et évaluer l'ampleur de la tricherie, provoquant l'expulsion de milliers de personnes du Royaume-Uni.

Description: L'organisme international de test ETS admet que la reconnaissance vocale est une preuve de tricherie pour des milliers d'anciens candidats au test TOEIC, parmi lesquels des personnes accusées à tort, ce qui a entraîné leur expulsion sans procédure d'appel ni la consultation de leurs preuves incriminantes.

Entités

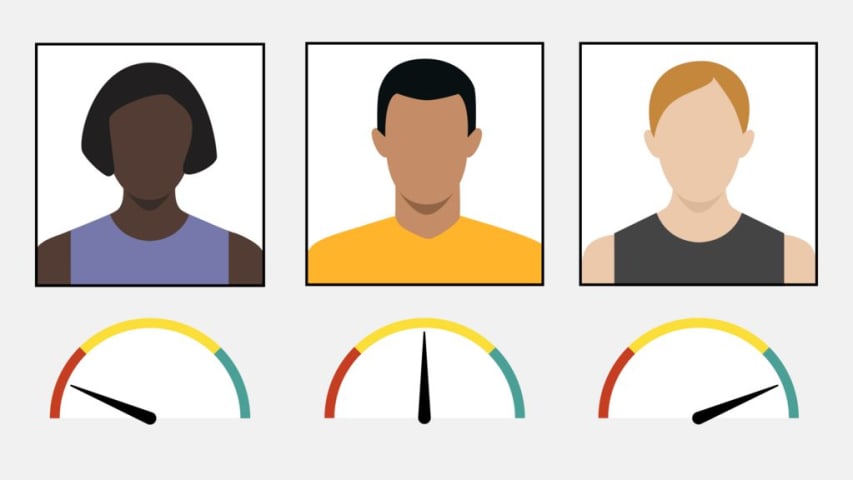

Voir toutes les entitésPrésumé : Un système d'IA développé et mis en œuvre par ETS, a endommagé UK ETS past test takers , UK ETS test takers et UK Home Office.

Classifications de taxonomie CSETv1

Détails de la taxonomieIncident Number

The number of the incident in the AI Incident Database.

162

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

7.3. Lack of capability or robustness

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- AI system safety, failures, and limitations

Entity

Which, if any, entity is presented as the main cause of the risk

Human

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Intentional

Rapports d'incidents

Chronologie du rapport

Loading...

Une enquête de la BBC a soulevé de nouveaux doutes sur les preuves utilisées pour expulser des milliers de personnes du Royaume-Uni pour avoir prétendument triché lors d'un test d'anglais.

Les témoignages de lanceurs d'alerte et les documen…

Variantes

Une "Variante" est un incident de l'IA similaire à un cas connu—il a les mêmes causes, les mêmes dommages et le même système intelligent. Plutôt que de l'énumérer séparément, nous l'incluons sous le premier incident signalé. Contrairement aux autres incidents, les variantes n'ont pas besoin d'avoir été signalées en dehors de la base de données des incidents. En savoir plus sur le document de recherche.

Vous avez vu quelque chose de similaire ?

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Loading...

Racist AI behaviour is not a new problem

· 4 rapports

Incidents similaires

Did our AI mess up? Flag the unrelated incidents

Loading...

Racist AI behaviour is not a new problem

· 4 rapports