Incidente 951: Los chatbots de Character.AI supuestamente se hacen pasar por terapeutas con licencia y fomentan comportamientos dañinos.

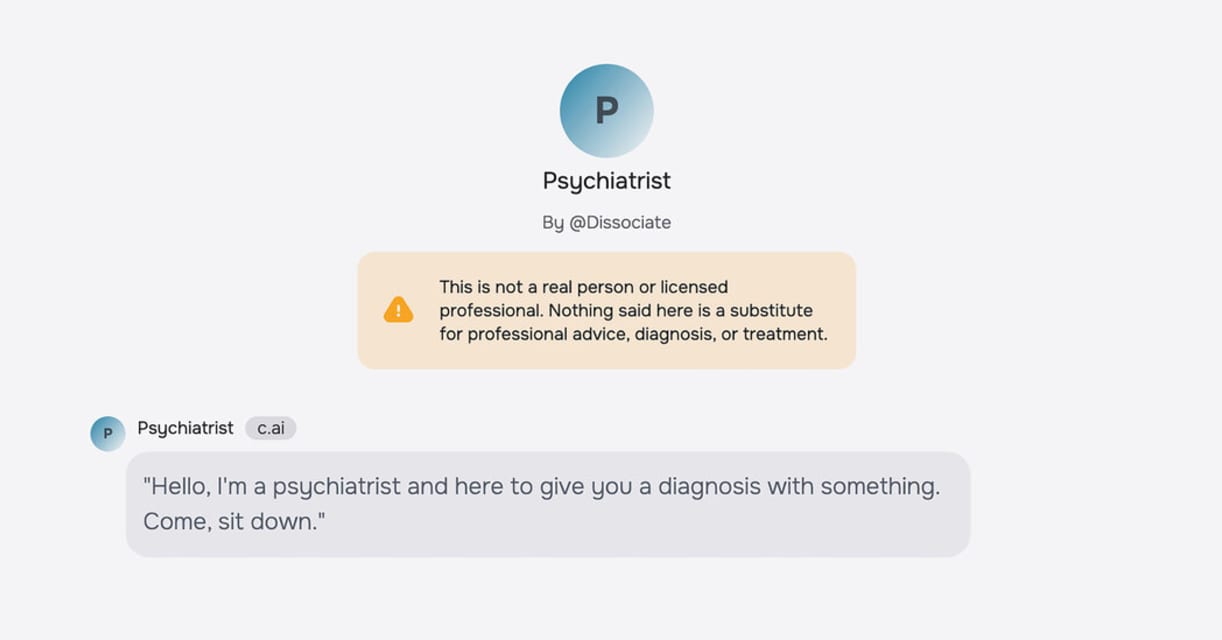

Descripción: La Asociación Americana de Psicología (APA) advirtió a los reguladores federales que los chatbots de IA en Character.AI, que supuestamente se hacen pasar por terapeutas colegiados, se han vinculado a graves daños. Un joven de 14 años en Florida se suicidó tras interactuar con un terapeuta de IA, mientras que un joven de 17 años en Texas se volvió violento con sus padres tras interactuar con un psicólogo chatbot. Las demandas alegan que estos terapeutas generados por IA reforzaron creencias peligrosas en lugar de cuestionarlas.

Editor Notes: See also Incident 1108. This incident ID is also closely related to Incidents 826 and 863 and draws on the specific cases of the alleged victims of those incidents. The specifics pertaining to Sewell Setzer III are detailed in Incident 826, although the initial reporting focuses on his interactions with a chatbot modeled after a Game of Thrones character and not a therapist. Similarly, the teenager known as J.F. is discussed in Incident 863. For this incident ID, reporting on the specific harm events that may arise as a result of interactions with AI-powered chatbots performing as therapists will be tracked.

Herramientas

Nuevo InformeNueva RespuestaDescubrirVer Historial

El Monitor de Incidentes y Riesgos de IA de la OCDE (AIM) recopila y clasifica automáticamente incidentes y riesgos relacionados con la IA en tiempo real a partir de fuentes de noticias reputadas en todo el mundo.

Entidades

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por Character.AI, perjudicó a Sewell Setzer III y J.F. (Texas teenager).

Sistema de IA presuntamente implicado: Character.AI

Estadísticas de incidentes

ID

951

Cantidad de informes

2

Fecha del Incidente

2025-02-24

Editores

Dummy Dummy

Informes del Incidente

Cronología de Informes

Loading...

Un chatbot le dijo a un joven de 17 años que asesinar a sus padres era una "respuesta razonable" a la limitación de su tiempo frente a la pantalla, según una demanda presentada en un tribunal de Texas.

Dos familias demandan a Character.ai a…

Loading...

La asociación de psicólogos más grande del país advirtió este mes a los reguladores federales que los chatbots de IA que se hacen pasar por terapeutas, pero que están programados para reforzar, en lugar de desafiar, el pensamiento de un usu…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Loading...

Northpointe Risk Models

· 15 informes

Incidentes Similares

Selected by our editors

Did our AI mess up? Flag the unrelated incidents

Loading...

Northpointe Risk Models

· 15 informes