Incidente 33: Amazon Alexa reproduce música a todo volumen cuando el propietario no está

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Unknown/unclear

Physical System

Consumer device

Level of Autonomy

Medium

Nature of End User

Amateur

Public Sector Deployment

Yes

Data Inputs

environment audio, Alexa software, user requests

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

33

Risk Subdomain

7.3. Lack of capability or robustness

Risk Domain

- AI system safety, failures, and limitations

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

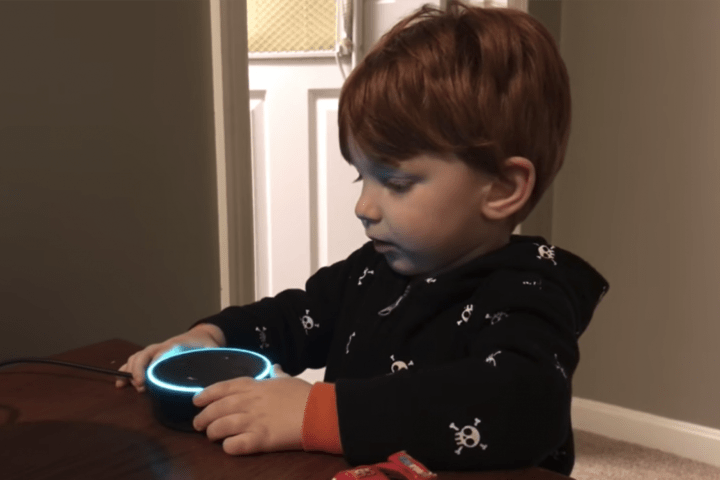

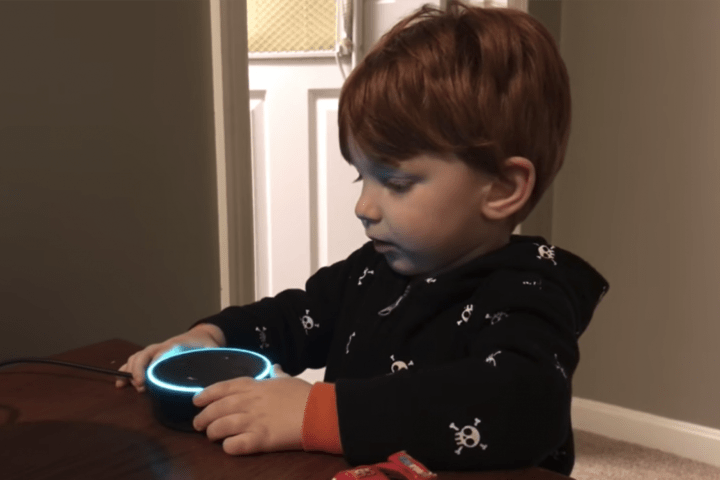

El futuro pertenece a los dispositivos impulsados por IA que reproducirán música y se divertirán solos cuando no estemos allí.

Al menos esa es la conclusión de un incidente curioso/inquietante que involucra a un chico alemán en Hamburgo.

Si…

Todos asumimos que los dispositivos inteligentes satisfarán todas nuestras necesidades o intentarán matarnos, pero ¿y si solo quieren divertirse?

Bueno, podría salir bastante caro, como descubrió Oliver Haberstroh cuando su Amazon Alexa com…

El dispositivo asistente personal de vigilancia de audio actualizado de Amazon, Alexa, ha adquirido una batería externa llamada Dox.

La tienda de energía portátil con el nombre apropiado, fabricada por la firma de artículos de estilo de vid…

En el pasado, hemos visto casos como el fracaso del bot Tay de Microsoft, cuando desarrolló una tendencia a hacer comentarios racistas. Dentro de las 24 horas de su existencia e interacción con las personas, comenzó a enviar comentarios ofe…

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Alexa Plays Pornography Instead of Kids Song

Game AI System Produces Imbalanced Game

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Alexa Plays Pornography Instead of Kids Song