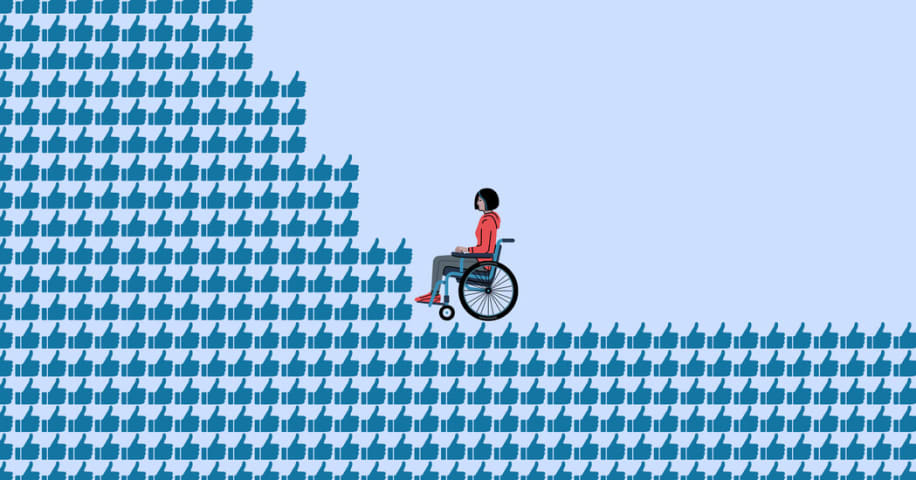

Incidente 142: El sistema de moderación de anuncios de Facebook identificó erróneamente, de forma rutinaria, productos de moda adaptativa como equipos médicos y bloqueó a sus vendedores.

Descripción: El sistema de moderación de anuncios automatizados de las plataformas de Facebook clasificó falsamente los productos de moda adaptable como productos y servicios médicos y de atención médica, lo que resultó en prohibiciones y apelaciones regulares por parte de sus minoristas.

Entidades

Ver todas las entidadesPresunto: un sistema de IA desarrollado e implementado por Facebook y Instagram, perjudicó a Facebook users of disabilities y adaptive fashion retailers.

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

The number of the incident in the AI Incident Database.

142

Risk Subdomain

A further 23 subdomains create an accessible and understandable classification of hazards and harms associated with AI

1.1. Unfair discrimination and misrepresentation

Risk Domain

The Domain Taxonomy of AI Risks classifies risks into seven AI risk domains: (1) Discrimination & toxicity, (2) Privacy & security, (3) Misinformation, (4) Malicious actors & misuse, (5) Human-computer interaction, (6) Socioeconomic & environmental harms, and (7) AI system safety, failures & limitations.

- Discrimination and Toxicity

Entity

Which, if any, entity is presented as the main cause of the risk

AI

Timing

The stage in the AI lifecycle at which the risk is presented as occurring

Post-deployment

Intent

Whether the risk is presented as occurring as an expected or unexpected outcome from pursuing a goal

Unintentional

Informes del Incidente

Cronología de Informes

Loading...

A principios de este año, Mighty Well, una empresa de ropa adaptada que fabrica ropa de moda para personas con discapacidades, hizo algo que hacen muchas marcas nuevas: intentó colocar un anuncio de uno de sus productos más populares en Fac…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?