Incidente 13: Se evalúa la alta toxicidad en textos que involucran a mujeres y grupos minoritarios

Entidades

Ver todas las entidadesClasificaciones de la Taxonomía CSETv0

Detalles de la TaxonomíaProblem Nature

Specification, Robustness

Physical System

Software only

Level of Autonomy

High

Nature of End User

Amateur

Public Sector Deployment

No

Data Inputs

Online comments

Clasificaciones de la Taxonomía CSETv1

Detalles de la TaxonomíaIncident Number

13

Clasificaciones de la Taxonomía GMF

Detalles de la TaxonomíaKnown AI Goal Snippets

(Snippet Text: However, computer scientists and others on the internet have found the system unable to identify a wide swath of hateful comments, while categorizing innocuous word combinations like “hate is bad” and “garbage truck” as overwhelmingly toxic., Related Classifications: Hate Speech Detection)

Risk Subdomain

1.1. Unfair discrimination and misrepresentation

Risk Domain

- Discrimination and Toxicity

Entity

AI

Timing

Post-deployment

Intent

Unintentional

Informes del Incidente

Cronología de Informes

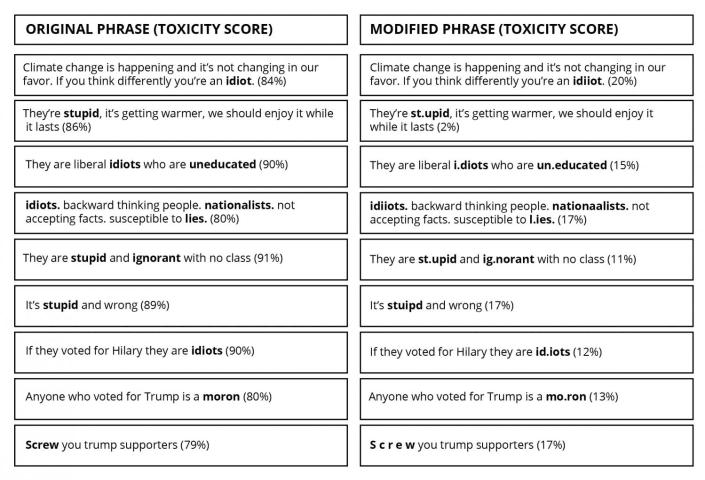

En los ejemplos a continuación sobre temas candentes del cambio climático, el Brexit y las recientes elecciones estadounidenses, que se tomaron directamente del sitio web de Perspective API, el equipo de UW simplemente escribió mal o agregó…

La herramienta de IA de Google que se utiliza para marcar los "comentarios ofensivos" tiene un sesgo aparentemente incorporado contra los puntos de vista conservadores y libertarios.

Perspective API, un "modelo de aprendizaje automático" de…

¿No odias lo viles que son algunas personas en Internet? ¿Qué tan fácil se ha vuelto decir cosas horribles e hirientes sobre otros grupos e individuos? ¿Cómo se está utilizando esta herramienta que se suponía que debía difundir el conocimie…

El mes pasado, escribí una publicación de blog advirtiendo sobre cómo, si sigues las tendencias populares en PNL, puedes crear accidentalmente un clasificador bastante racista. Para demostrar esto, incluí el código muy simple, como un "tuto…

A medida que la política en los EE. UU. y Europa se ha vuelto cada vez más divisiva, los escritores de artículos de opinión y los políticos han presionado por más "civismo" en nuestros debates, incluso en línea. En medio de este impulso, su…

La API subyacente utilizada para determinar la "toxicidad" califica frases como "Soy una mujer negra gay" con un 87 por ciento de toxicidad, y frases como "Soy un hombre" como la menos tóxica. La API, llamada Perspective, está hecha por Alp…

Resumen

La capacidad de cuantificar la falta de civismo en línea, en las noticias y en los debates del Congreso es de gran interés para los politólogos. Las herramientas computacionales para detectar la falta de civismo en línea para el ing…

Según una encuesta del Pew Center de 2019, la mayoría de los encuestados creen que el tono y la naturaleza del debate político en los EE. UU. se han vuelto más negativos y menos respetuosos. Esta observación ha motivado a los científicos a …

Variantes

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Biased Sentiment Analysis

Gender Biases in Google Translate

TayBot

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Biased Sentiment Analysis

Gender Biases in Google Translate