Incidente 1011: Una falsificación profunda del primer ministro de Bermudas, David Burt, promueve una estafa de inversión usando la marca Royal Gazette.

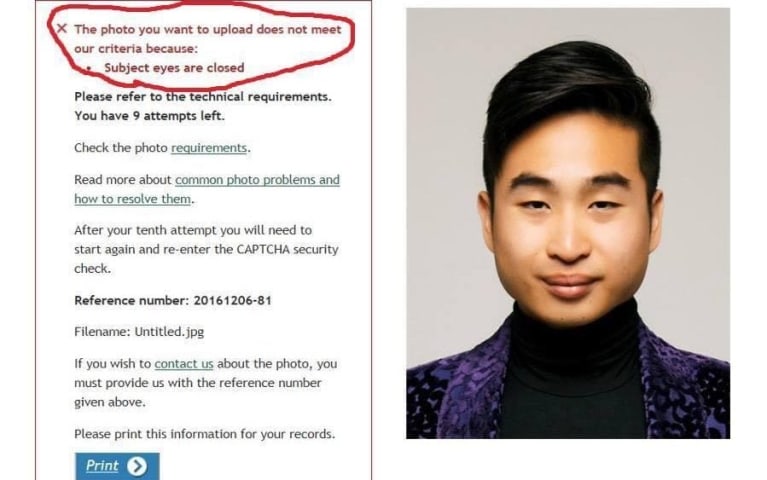

Descripción: El Gobierno de Bermudas advirtió al público sobre un video deepfake que circulaba en Facebook y que mostraba falsamente al primer ministro David Burt promocionando un plan de inversión gubernamental. El video, supuestamente falso, imitaba la imagen de The Royal Gazette y estaba vinculado a cuentas fraudulentas en redes sociales. Las autoridades confirmaron que el contenido era falso e instaron al público a denunciar este tipo de estafas y a estar alerta.

Entidades

Ver todas las entidadesAlleged: Unknown deepfake technology developer y Unknown voice cloning technology developer developed an AI system deployed by scammers , Fraudsters y Scammers impersonating David Burt, which harmed David Burt , Government of Bermuda , General public of Bermuda y The Royal Gazette.

Sistemas de IA presuntamente implicados: Unknown deepfake app , Unknown voice cloning technology , Facebook y Social media platforms

Estadísticas de incidentes

ID

1011

Cantidad de informes

1

Fecha del Incidente

2025-04-05

Editores

Dummy Dummy

Informes del Incidente

Cronología de Informes

Loading...

El Gobierno ha advertido al público sobre un video falso generado por IA que circula en redes sociales.

El video, visto en Facebook, incluía una imagen que sugería falsamente estar relacionada con un informe de The Royal Gazette e incluía i…

Variantes

Una "Variante" es un incidente de IA similar a un caso conocido—tiene los mismos causantes, daños y sistema de IA. En lugar de enumerarlo por separado, lo agrupamos bajo el primer incidente informado. A diferencia de otros incidentes, las variantes no necesitan haber sido informadas fuera de la AIID. Obtenga más información del trabajo de investigación.

¿Has visto algo similar?

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents

Incidentes Similares

Did our AI mess up? Flag the unrelated incidents